Patrick's 데이터 세상

사내 교육 4주차 - 딥 러닝 개요 본문

딥 러닝 Deep Learning

머신 러닝의 특정한 한 분야

인공 신경망(Artificial Neural Network)의 층을 연속적으로 쌓아 올려 데이터를 학습하는 방식

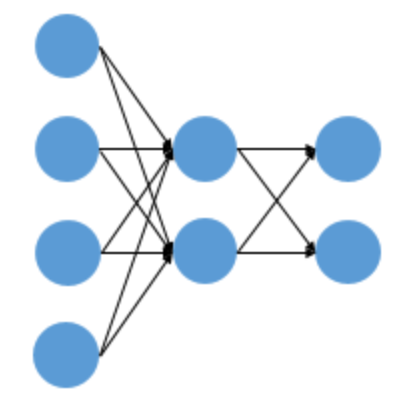

퍼셉트론 Perceptron

딥 러닝 신경망의 원리는 인간의 뇌 구조인 뉴런을 본떠서 만든 개념

미국의 신경생물학자인 프랑크 로젠블라트가 1957년에 제안한 초기 형태의 인공 신경망.

다수의 입력으로부터 하나의 결과를 내보내는 알고리즘.

실제 뇌에서는 가지돌기에서 신호를 받아들이고, 축삭돌기를 통해 다른 뉴런으로 신호를 전달.

x : 입력 값, w : 가중치 weight, y : 출력 값, 파란 원 : 뉴런

축삭돌기 - 가중치

단층 퍼셉트론 Single-Layer Perceptron

입력층, 출력층 두 단계로만 이루어진 퍼셉트론

논리 게이트

0, 1 두 개의 값을 입력해 하나의 값을 출력하는 회로

오직 두 개의 입력값이 1인 경우에만 1 출력

두 개의 입력이 모두 1인 경우에 출력이 0이고 나머지 경우에 모두 출력이 1

두 개의 입력이 모두 0인 경우에 출력이 0이고 나머지 경우에 모두 출력이 1

입력값 두 개가 서로 다른 값일 때만 출력이 1이고, 같은 값이면 0

다층 퍼셉트론 MultiLayer Perceptron, MLP

단층 퍼셉트론에 비해 중간에 은닉층을 추가한 퍼셉트론

인공 신경망 Artificial Neural Network

피드 포워드 신경망 Feed-Forward Neural Network, FFNN

오직 입력층에서 출력층 방향으로 연산이 전개되는 신경망

전결합층 Fully-connected layer, Dense layer

어떤 층의 모든 뉴런이 이전 층의 모든 뉴런과 연결돼 있는 층

활성화 함수 Activation Function

은닉층과 출력층의 뉴런에서 출력층을 결정하는 함수

특징 : 비선형 함수 Nonlinear function

선형 함수

비선형 함수 : 직선 1개로는 그릴 수 없는 함수

선형 함수로 은닉층을 두 개 추가

계단 함수 Step function

0보다 작으면 0, 0보다 크면 1인 함수

시그모이드 함수 Sigmoid function

해당 식으로 통해 S자 시그모이드 곡선을 그리는 함수

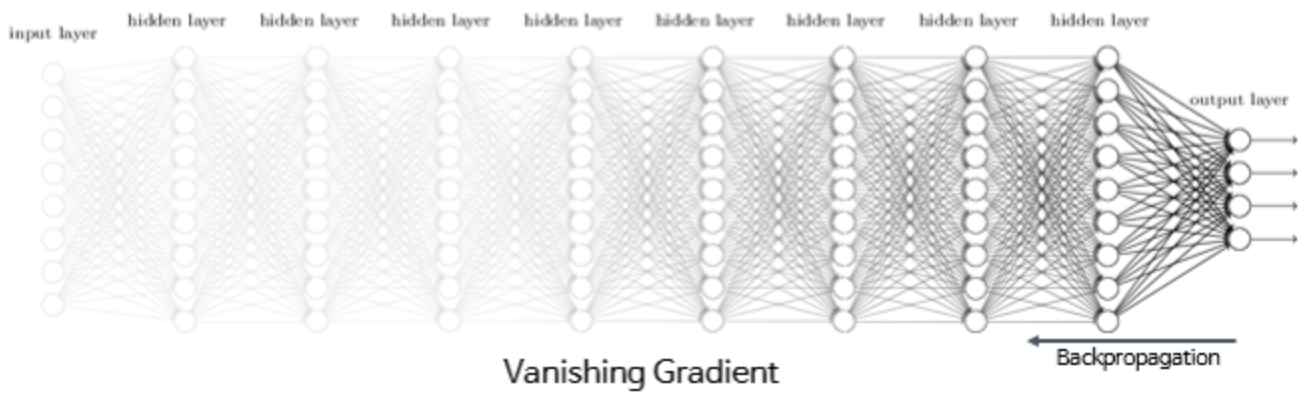

기울기 소실 문제 발생

하이퍼볼릭탄젠트 함수 Hyperbolic tangent function

입력값을 -1과 1사이로 출력하는 함수

렐루 함수 ReLU function

입력값이 음수이면 0을 출력, 양수이면 입력값을 그대로 반환하는 함수

단순한 임계값이므로 연산 속도가 빨라 은닉층에서 가장 많이 사용.

리키 렐루 함수 Leaky ReLU function

죽은 렐루 현상을 보완하기 위해 나온 ReLU 변형 함수

입력값이 음수일 경우 0이 아니라 0.001과 같은 매우 작은 수를 반환하는 함수

소프트맥스 함수 Softmax function

세 가지 이상의 선택지 중 하나를 고르는 다중 클래스 분류 문제에 주로 사용되는 활성화 함수

딥 러닝 학습 방법

순전파

입력층에서 출력층 방향으로 연산을 진행하는 과정

활성화 함수, 은닉층 수, 은닉층 뉴런 수 등을 설정하고 입력값을 받으면 입력층, 은닉층을 지나면서 입력값은 각각의 가중치와 연산되어 출력층으로 향함

순전파의 행렬곱

입력층 뉴런, 입력 차원 : 3, 출력층 뉴런, 출력 차원 : 2

손실 함수 Loss function

순전파에서 입력 값을 연산을 하고 순전파 연산에서 실제값과 예측값의 오차를 계산하는 함수

MSE Mean Squared Error

선형 회귀에서 연속성 변수를 예측할 때, 사용하는 손실 함수

이진 크로스 엔트로피 Binary Cross-Entropy

이진 분류에서 0과 1사이의 연속적인 출력을 내는 시그모이드와 함께 사용하는 손실 함수

범주형 크로스 엔트로피 Categorical Cross-Entropy

다중 클래스 분류에서 소프트맥스 활성화 함수와 함께 사용하는 손실 함수

경사 하강법

'Deep Learning > NLP 강의' 카테고리의 다른 글

| 사내 교육 5주차 - 모델 변천사 (0) | 2023.03.27 |

|---|---|

| 사내 교육 3주차 - 머신러닝 (0) | 2023.03.10 |

| 사내 교육 2주차 - 단어 임베딩 (0) | 2023.03.05 |

| 사내 교육 1주차 - 자연어 처리 입문 (0) | 2023.02.18 |